MIT の研究 : AI 利用による知能活動の低下

(全体俯瞰 : AI 生成) click で拡大

前置き+コメント

MIT の論文 "Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task" (2025-06)

と、その関連記事を AI(NotebookLM) で整理した。

まとめ として

AIに思考を「丸投げ」するのではなく、まず人間が考え、その上でAIを能力拡張のツールとして使いこなす「主体性」こそが、AI時代における知性の鍵であると結論付けています。

とあるが、遠からずそういった「主体性」も AI のパワーでねじ伏せられる筈。つまり、人間が「主体性」を駆使してどう足掻こうが、その主体性(=無能な働き者)こそが成果物の最大の欠陥因子となる。

既に、プログラミング/コーディング においては、そういった余計な「主体性」なるものは邪魔となってきつつある。

極端に言えば、数万行程度の簡単なソフトなら

- ぼんやりした曖昧な仕様を AI と詰め(= AI に具体化してもらい)、

- データ構造/アルゴリズム 設計を含めたコード生成(+テスト)の大部分は AI にお任せし、

- 人間サマは、AI から提案された複数の実装の中からどれが良さそうかを選ぶだけ

…そういう方向に急速に向かっている。AI には任せられないというプログラマは、しがらみだらけの旧組織を引きずった統合会社や、役所の特殊事例がてんこ盛りの汚物のようなデータと心ゆくまで末永く格闘し続けて下さいw

情�報源

その他 10件の記事(URL は省略)

要旨

MITの研究によると、AIへの丸投げは脳の活性化を妨げ、長期的な認知機能の低下を招く恐れがあります。一方、自ら考えた上でAIを補助的に使うと、脳はより活性化し能力拡張に繋がります。AIに依存せず、人間ファーストの思考を保つことが重要です。

目次

AI が脳に与える影響(MIT 研究)

2025年の教育とAIに関する広範なリソースの中で、MITメディアラボによる「Your Brain on ChatGPT(ChatGPT使用時の脳)」という研究は、AIの利便性が人間の認知能力に及ぼす「代償」を科学的に裏付ける極めて重要な転換点として扱われています。

提供されたソースに基づき、この研究が文脈の中で何を主張しているのかを以下の4つの重要ポイントで説明します。

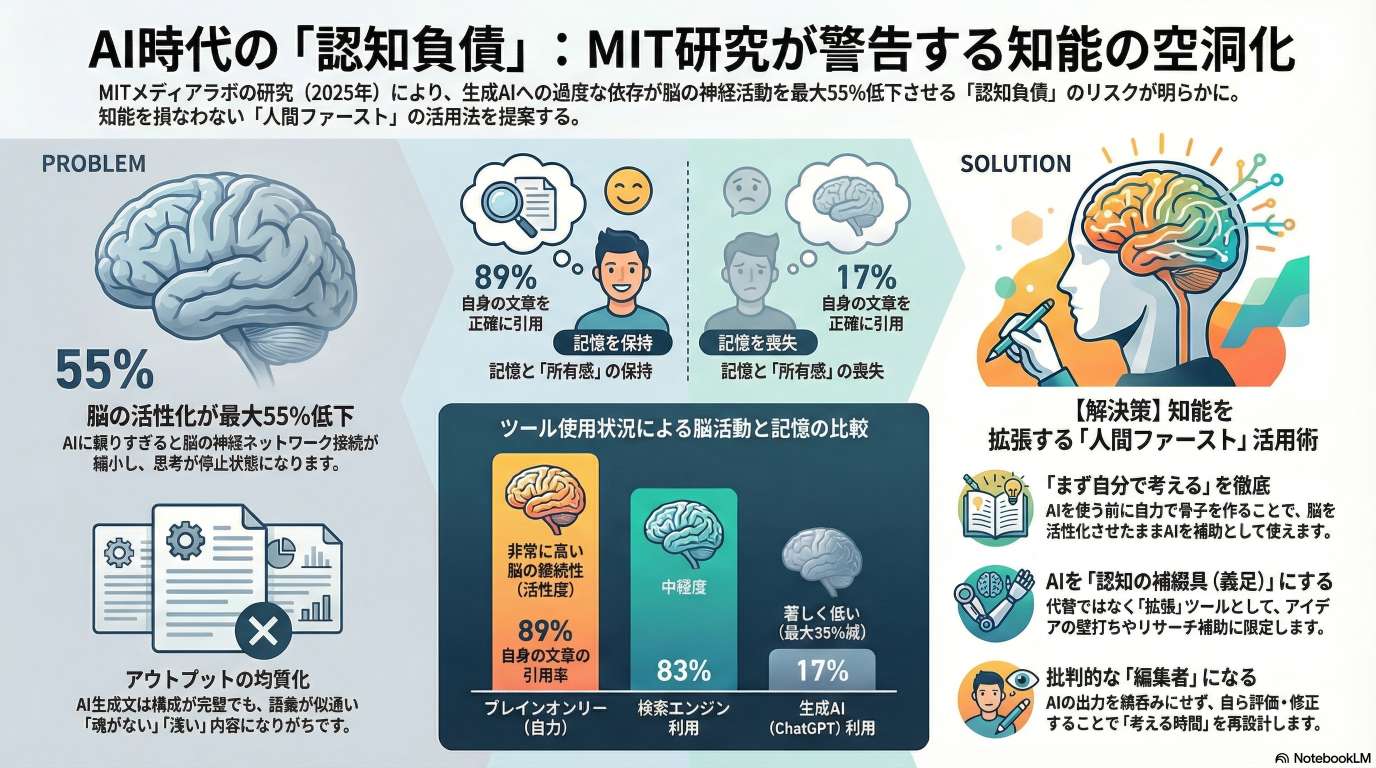

1. 「認知負債(Cognitive Debt)」という新たなリスクの提示

MITの研究チーム(Nataliya Kosmyna博士ら)は、生成AIに過度に依存することで、短期的には高いパフォーマンスが出ても、長期的には学習能力や思考力が損なわれる現象を「認知負債(Cognitive Debt)」と名付けました,。

- 脳活動の低下: エッセイ作成タスクにおいて、AI(ChatGPT)を使用したグループは、自力で書いたグループや検索エンジンを使用したグループと比較して、脳の神経接続(コネクティビティ)が著しく低く、最大で55%活動が低下していることが脳波(EEG)測定で確認されました,,。

- 所有感と記憶の欠如: AIを使用した参加者のエッセイは文法や構成が完璧であるにもかかわらず、本人はその内容をほとんど記憶しておらず(引用できたのはわずか17%)、自分が書いたという「所有感」も希薄でした,,。

- 同質化: AIが生成した文章は多様性に欠け、均質化(homogenization)していることも指摘されています,。

これは、教育現場で懸念されていた「認知的オフローディング(思考のアウトソーシング)」が、実際に脳の活動低下を招いていることを示す証拠として引用されています,。

2. 「使い方」による脳への影響の違い(人間ファーストの重要性)

この研究の最も重要な発見の一つは、AIが常に脳に悪影響を与えるわけではないという点です。研究では、AIを使用するタイミングによって脳への影響が逆転することが示されました。

- 早期依存の弊害: 最初からAIに頼ったグループは、後に自力で書こうとしてもパフォーマンスが低く、脳活動も不活発なままでした,。

- 「拡張」としてのAI: 一方で、最初に自力で思考・執筆を行ったグループ(Brain-only)が、その後の修正や改善の段階でAIを使用した際、脳活動は低下せず、むしろ活性化したことが確認されました,,。

この結果は、AIを「思考の代替」としてではなく、基礎的な思考力を身につけた後の「認知の拡張(補綴具)」として使うべきであるという教育的アプローチを支持しています,。2025年の文脈では、これを「人間ファースト(Human-First)」のアプローチや「Human-in-the-loop」の重要性として議論しています,。

3. 「ブレイン・ロット(脳の腐敗)」論争への科学的視座

2025年の教育界では、学生の90%以上がAIを使用している現状があり、AIによる「ブレイン・ロット(脳の機能低下)」への懸念が高まっています。

- スキルの空洞化: MITの研究結果は、AIによる表面的な効率化の裏で、批判的思考や記憶の形成といった深い学習プロセスが阻害されていることを示唆しており、教育者が抱く「スキル喪失(Deskilling)」への恐れを補強しています,。

- 反論と擁護: 一方で、Ethan Mollick氏などの専門家は、この研究結果を受け止めつつも、「脳の損傷」という極端な解釈には慎重であるべきだと主張しています。適切なガイダンスと足場かけ(スキャフォルディング)があれば、AIは学習を促進する可能性があるとも指摘されています,。

4. 教育現場への実践的な示唆

この研究は、単なる警告にとどまらず、2025年以降の教育カリキュラムや評価方法の再設計に向けた具体的な指針を提供しています。

- プロセスの重視: 成果物(エッセイの完成品)だけを評価するのではなく、思考のプロセス自体を評価する必要性が強調されています,。

- AI導入のタイミング: 学習者が十分な認知的努力(自力での思考)を行った後にAIを導入するという、「AI統合の遅延」モデルが推奨されています。

- 教育の再定義: AIが「答え」を出すツールでは��なく、思考を深めるための「壁打ち相手」として機能するように、課題設計を見直す必要があると論じられています,。

結論

2025年の文脈において、MITの研究は「AI禁止論」に戻るためのものではなく、「思考リテラシー」を守りながらAIと共存するための科学的根拠として機能しています。ソースは、AIに思考を「丸投げ」するのではなく、まず人間が考え、その上でAIを能力拡張のツールとして使いこなす「主体性」こそが、AI時代における知性の鍵であると結論付けています,。

教育におけるAI:2025年の主要テーマと洞察に関するブリーフィング

エグゼクティブサマリー

本ブリーフィングは、2025年における高等教育分野での人工知能(AI)の動向、影響、および主要な議論を包括的にまとめたものである。提供された情報源を詳細に分析した結果、以下の5つの核心的テーマが浮かび上がった。

- 認知への影響と「認知的負債」:マサチューセッツ工科大学(MIT)の画期的な研究「Your Brain on ChatGPT」は、AIへの早期依存が脳の活動を低下させ、記憶力や所有感を損ない、「認知的負債」を生み出すことを明らかにした。一方で、自力で思考した後にAIを使用すると、逆に脳活動が活発化することも示唆され、AIの賢明な利用法に関する議論が活発化している。

- 学問的誠実性の危機と評価の転換:AIによる不正行為が蔓延し、従来の盗作モデルと検出ツールは機能不全に陥っている。これに対し、教育機関は手書き試験や口頭試験への回帰といった対抗策を講じる一方、クレイ・シャーキーが提唱する「ポスト盗作(Post-Plagiarism)」の概念に基づき、AIの存在を前提とした評価方法の再設計へとシフトしつつある。

- 教育実践と制度的対応の混乱:教員はAIを業務効率化のツールとして利用する一方で、その導入は労働の価値低下や不公平感といった新�たな課題を生んでいる。「AI配当」という時間節約の恩恵が議論される中、多くの教育機関では統一されたAI戦略が欠如しており、場当たり的な対応に終始している。シラバスでの明確な方針提示や、教員向けの体系的な研修が急務となっている。

- AI産業の変動と教育技術(EdTech)の再編:AI技術は自律的にタスクを遂行する「AIエージェント」やマルチモーダル機能へと急速に進化している。しかし、その裏では「GenAIバブル崩壊」の可能性が指摘され、大手テック企業による寡占化が進行している。特に、Googleのような巨大企業が自社プラットフォームにAIを統合することで、小規模なEdTechスタートアップは存続の危機に瀕している。

- 倫理的・社会的懸念の増大:AIモデルに内在するバイアス、データセンターの環境負荷、学生の精神衛生への悪影響、著作権問題など、倫理的・社会的な課題が山積している。AIが生成する偽情報によって「ポストリアリティ」時代が到来するとの警鐘も鳴らされており、教育現場では情報リテラシー教育の抜本的な見直しが求められている。

総じて、2025年はAIが教育現場に不可逆的な変化をもたらした年として記憶されるだろう。単なるツールとしての導入(Adoption)から、教育のあり方そのものへの適応(Adaptation)へと移行することが、すべての教育関係者にとっての喫緊の課題となっている。

1. AIと認知・学習への影響:MIT「ChatGPT脳」研究の衝撃

2025年6月に発表されたMITメディアラボの研究「Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task」は、生成AIの利用が人間の認知プロセスに与える影響について、科学的根拠に基づいた衝撃的な洞察を提供した。この研究は、教育分野におけるAIの役割をめぐる議論の中心となっている。

研究の設計と主要な発見

研究では、参加者を3つのグループに分け、エッセイ作成タスクにおける脳活動を脳波(EEG)で測定した。

| グループ | 使用ツール | 主要な発見 |

|---|---|---|

| ブレインオンリー | 外部ツールなし | 脳の神経接続が最も活発。記憶の定着率が高く、エッセイへの所有感も強い。 |

| 検索エンジン | Google等の検索エンジン | ブレインオンリー群よりは低いが、脳活動は維持されている。情報統合や判断力が機能。 |

| LLM (ChatGPT) | ChatGPT-4o | 脳活動が著しく低下。作成した内容の記憶が曖昧で、エッセイへの所有感が希薄。 |

主な研究結果

- 脳活動の低下:LLMを使用したグループは、思考や記憶、注意に関連する脳領域の活動が、検索エンジン使用グループと比較して最大55%低下した。これはAIに思考プロセスを「丸投げ」した結果、脳が省エネモードに入ったことを示唆する。

- 記憶力と所有感の喪失:タスク後、自身が作成したエッセイの内容を正確に引用できた割合は、ブレインオンリー群の89%に対し、LLM群はわずか17%であった。また、「自分で書いた感覚がある」と回答した割合も、LLM群は45%に留まった。

- 思考の均質化:LLMで生成されたエッセイは、語彙や構成が均質化する傾向が強く、人間の教員からは「構成は完璧だが、魂がない」「表面的で主張が弱い」と評価された。

- 「認知的負債(Cognitive Debt)」の概念:研究者らは、AIの利便性と引き換えに思考力が低下するこの現象を「認知的負債」と名付けた。これは、短期的な効率化のために、長期的な思考能力という知的資産を損なっている状態を指す。

学習におけるAI活用の新たな指針

この研究で最も重要な発見の一つは、AIの使用順序が認知に与える影響である。

- 初期段階からのAI依存:学習プロセスの最初からAIに頼ると、思考が浅くなり、知識の定着が妨げられる。

- 自力思考後のAI活用:一方、まず自力で考え、アイデアを練った後にAIを壁打ち相手やリサーチ補助として使用した場合、脳の神経接続はむしろ増加した。これは、AIが思考の「代替」ではなく「拡張」ツールとして機能したことを示している。

この結果は、AIを教育から排除するのではなく、思考力を損なわない形で統合するための具体的な指針を提供するものである。��「まず自分で考える」という原則が、AI時代の学習において極めて重要となる。

2. 学問的誠実性と不正行為の危機

生成AIの普及は、大学における学問的誠実性の概念を根底から揺るがしている。従来の盗作や剽窃とは異なり、AIが生成した文章はオリジナリティの判断が困難であり、教育現場は深刻な課題に直面している。

「ポスト盗作」時代の到来

- 不正行為の常態化:『New York Magazine』の記事「Everyone Is Cheating Their Way Through College」に象徴されるように、学生によるAI利用は日常的なものとなった。これは単なる怠慢ではなく、コロナ禍以降の教育環境の変化や経済的圧力といった構造的な問題に起因するとの指摘もある(Elsie McDowell)。

- 検出ツールの限界:AIが生成した文章を教員が見抜くことは極めて困難であり、ある研究では97%が見逃されたと報告されている。AI検出ツールも信頼性が低く、監視と処罰を基本とする従来のアプローチは限界を迎えている。

- クレイ・シャーキーの「ポスト盗作大学」:この状況に対し、思想家のクレイ・シャーキーは、AI利用を不正行為として一方的に断罪するのではなく、それが存��在する現実として受け入れ、新たな学問的誠実性の規範を構築すべきだと主張する。これは、AIをツールとしてどう倫理的に利用するかを学生と共に考える教育への転換を意味する。

教育現場の対応策

教育機関の対応は、大きく二つの方向に分かれている。

- AIを排除するアプローチ:手書きの試験やブルーブック、口頭試験を復活させる動きが見られる(「The Handwriting Revolution」)。これはAIによる不正を物理的に不可能にするための対抗策である。

- AIを統合するアプローチ:デラウェア大学のMatt Kinservik教授の実践のように、AIを使わないリサーチを課した上で、AIが生成した文章を批判的に分析・修正させる課題を設計する。これにより、学生はAIの限界を学び、人間ならではの編集能力や事実確認の重要性を体得する。

教育学者のElizabeth Wardleは、この問題の根本はAIではなく、学習よりも成績を優先する大学教育の構造的な欠陥にあると指摘しており、評価方法そのものの抜本的な見直しを求めている。

3. 教育実践と評価の再設計

AIの台頭は、教育者に対し、何を、どのように教え、どう評価するのかという根本的な問いを突きつけている。不正行為への対応�という守りの姿勢から、AIを前提とした教育モデルを構築する攻めの姿勢への転換が求められている。

新たな教育モデルとフレームワーク

- AIリテラシー教育の重視:Mike Caulfieldが提唱する「SIFT for AI」は、従来のSIFT(Stop, Investigate, Find, Trace)フレームワークをAI時代に適応させたもので、AIの出力を鵜呑みにせず、その主張を根拠まで遡って検証する具体的なスキルを教えることを目的としている。

- 評価方法の多様化:従来のレポートや論文に代わり、プロセスを重視した評価(ただしJason Gulyaは安易なプロセス主義に警鐘を鳴らす)、口頭での質疑応答、プロジェクトベースの学習などが再評価されている。

- 逆転ブルーム分類学(Inverted Bloom's Taxonomy):Michelle Kassorlaが提唱するこのモデルは、AI時代における学生の学習プロセスを的確に捉えている。従来は「記憶」から「創造」へと進んだが、AIを使うとまず「創造(AIによる生成)」から始まり、その後「分析」「評価」「理解」へと進む。教育者はこの新たな認知プロセスに合わせた指導設計が必要となる。

- 人間中心のA.S.K.フレームワーク:Lilian Minaがバングラデシュで導入したこのフレームワークは、AI活用を以下の3つの原則に基づいている。

- Augment teacher work(教員の仕事を補強する)

- Support student learning(学生の学習を支援する)

- Keep humans at the center(人間を常に中心に置く)

4. 教員の労働と制度的対応

AIは学生だけでなく、教員の働き方や大学の運営にも大きな影響を及ぼしている。しかし、その対応は場当たり的で、多くの課題が未解決のままである。

「AI配当」をめぐる議論

- 時間節約の恩恵:GallupとWalton Foundationの調査によると、AIを週に一度利用する教員は、授業準備や事務作業にかかる時間を約6時間節約できるという「AI配当」が報告された。

- 労働価値への懸念:一方で、Leon FurzeやMarc Watkinsといった批評家は、「時間節約」という指標が教育の本質を見誤らせると警告する。彼らは、効率化の名の下に教員の専門性や裁量が奪われ、結果的により多くの業務を課されるリスクを指摘する。Watkinsは、AIの導入が特に非常勤講師の労働環境を悪化させる可能性に言及している。

制度的対応の遅れと課題

- 戦略なき導入:『Inside Higher Ed』が実施した大学の最��高技術責任者(CTO)への調査では、AIへの依存度が高まっているにもかかわらず、包括的なAI戦略を持つ大学はわずか11%に過ぎないことが明らかになった。

- 方針の不統一:多くの大学で統一されたガイドラインが欠如しており、教員個人の判断に委ねられている。これにより、学生は授業ごとに異なるルールに直面し、混乱が生じている。AWAC(Writing Across the Curriculum)は、方針策定のための5つの推奨事項(まず聞く、多様な意見のバランスをとる、慎重に反復する、公開で試す、利用しやすくする)を提示している。

- 「導入」から「適応」へ:Marc Watkinsは、多くの大学が技術を単に「導入(Adopting)」することに終始していると批判し、教育の価値観や目的に合わせて技術を「適応(Adapting)」させることの重要性を強調している。

先進的な事例として、ニューヨーク州立大学(SUNY)ストーニーブルック校の図書館がAI担当ディレクターを雇用し、全学的なAIリテラシー教育のハブとして機能している点が注目される。

5. AI産業の動向と教育テクノロジー

教育現場での混乱の背景には、AI産業自体の急激な技術革新と熾烈な市場競争がある。これらの動向は、教育の未来を左右する重要な要素である。

技術の進化と市場の変動

- AIエージェントと自律性の向上:OpenAIの「Agents」に代表されるように、AIは単にコンテンツを生成するだけでなく、ブラウザを操作してオンラインコースを完了するなど、自律的に複雑なタスクを実行する能力を獲得しつつある(Agentic AI)。これは教育の評価システムに新たな脅威をもたらす。

- ディープリサーチとマルチモーダル:AIは表層的な情報検索から、複数の情報源を統合・分析して研究に近いアウトプットを生成する「ディープリサーチ」ツールへと進化している。また、テキストだけでなく画像、音声、動画を統合的に扱うマルチモーダル機能も標準となりつつある。

- GenAIバブル崩壊の懸念:Leon FurzeやGary Marcusらは、現在のAIへの過剰な投資と期待が、ドットコムバブルや暗号資産バブルと同様の崩壊を迎える可能性があると予測している。MITの調査では、企業のAIパイロットプロジェクトの95%が失敗に終わっていると報告されており、AIの現実的な価値と市場の期待との間に乖離が見られる。

- ビジネスモデルの転換:Alberto Romeroは、OpenAIが広告モデルへの移行を迫られている点を指摘し、これがLLMの維持コストの高さを物語っていると分析する。広告主が真の顧客となれば、AIの応答が商業的利益によって歪められる危険性がある。

教育テクノロジー(EdTech)市場の再編

Wess Trabelsiは、Googleが自社の教育プラットフォーム(Google Classroom)に高性能AI「Gemini」を無料で統合したことが、EdTech市場の転換点になったと指摘する。これにより、OpenAIのAPIを利用した小規模な「ラッパーアプリ」を開発していた多くのスタートアップが競争力を失い、市場からの撤退を余儀なくされている。巨大テック企業による寡占化は、教育分野におけるイノベーションの多様性を損なう恐れがある。

6. 倫理的・社会的懸念

AIの急速な普及は、効率化や利便性を超えた、より広範な倫理的・社会的課題を提起している。教育機関は、これらの問題について学生と議論し、批判的な視点を育む責任を負っている。

主要な懸念事項

- バイアスと公平性:Leon Furzeは、AIのトレーニングデータに内在するバイアスが、有害なステレオタイプを再生産し続ける問題を指摘している。

- 環境への影響:Molly Taftは、AIデータセンターが大量の水を消費するという主張について、その計算の複雑さと文脈の重要性を説き、安易な批判に警鐘を鳴らしている。

- 精神衛生へのリスク:カリフォルニア州立大学のMartha Lincolnは、ChatGPTのようなチャットボットが学生の精神的な脆弱性を悪化させる可能性があるとして、大学とのパートナーシップ解消を求めている。

- 著作権と知的財産:学術出版社がAIによる学習を防ぐために論文要旨へのアクセスを制限し始めている(Aaron Tay)。これは学術研究の自由なアクセスを阻害する可能性がある。

- 情報環境の汚染(Slop):Gary Marcusは、AIによって生成される低品質で信頼性の低いコンテンツ(AI slop)が、インターネットや学術界を汚染していると警告する。

- 人間性の侵食:Alberto Romeroは、AIが生成する均質化された英語スタイルが人間の言語表現を貧困化させると主張(「The Death of the English Language」)。また、AIによって現実と虚構の区別がつかなくなる「ポストリアリティ」時代の到来を懸念している。

- 人間関係の希薄化:AIとの対話が、学生同士の協調学習や議論といった社会的な学びの機会を奪い、大学体験をより孤独なものにするとの指摘もある(『The Chronicle』)。

これらの課題に対し、Gwendolyn Reeceは、人間を対象とする研究倫理の基本原則を定めた「ベルモント・レポート」(個人の尊重、恩恵、正義)が、AI倫理のフレームワークとしても応用可能であると提案している。

(2026-02-02)